Wie MOTRA sich seinen Gegenstand selbst erfindet

MOTRA misst nicht einen sauber definierten Gegenstand, sondern die Nutzung zuvor etikettierter Medienmarken durch Befragte, deren Antworten in normativ geladene Einstellungsindizes übersetzt und anschliessend in einen sicherheitspolitischen Deutungsrahmen gestellt werden; genau deshalb ist der Ansatz für starke Erkenntnisansprüche methodisch zu schwach.

Auf die hier besprochene MOTRA-Erhebung bin ich durch Roland Tichys Beitrag vom 22. April 2026 aufmerksam geworden. Der Text von Tichy hat einen Nerv getroffen, weil er ein reales Unbehagen benennt. Nur bleibt er an vielen Stellen dort stehen, wo Polemik stehen bleibt: bei Zuspitzung, Verdacht, Empörung. Mich interessiert an so einem Fall etwas anderes. Mich interessiert der Gegenstand. Denn sobald ein Forschungsprojekt mit dem Gestus sachlicher Vermessung auftritt, aber den zu vermessenden Gegenstand bereits begrifflich weich hält, ist der Rest nur noch numerisch aromatisierter Nebel.1 2 3

MOTRA ist ein staatlich grundierter Forschungsverbund der zivilen Sicherheitsforschung, gefördert durch drei Bundesministerien, gerahmt als „Monitoringsystem und Transferplattform Radikalisierung“, mit erklärtem Transferanspruch in Politik und Praxis. Die Projektbeschreibung sagt offen, das Monitoring solle eine Informationsbasis für prognostische Aussagen mit bedeutsamer Güte schaffen und damit eine evidenzbasierte, repressiv und präventiv ausgerichtete Sicherheitspolitik unterstützen. Wer hier noch so tut, als schwebe das Ganze in einem sterilen Raum methodischer Unschuld, verwechselt Liturgie mit Wissenschaft.

Mein Interesse richtet sich deshalb auf die Vorfrage, die in der Debatte fast konsequent umgangen wird: Was genau wird hier eigentlich gemessen. MOTRA und sein Alternativmedien-Kapitel tun so, als wäre das Objekt ihrer Erhebung bereits vorhanden, sauber konturiert, wissenschaftlich eingefangen. Gerade das ist nicht der Fall. Die methodische Schwäche beginnt nicht erst bei Stichprobengrösse, Gewichtung oder Signifikanz. Sie beginnt bereits dort, wo der Gegenstand definitorisch zerfliesst. Wo aber der Gegenstand schon begrifflich zerläuft, kann die spätere Messung keine harte Erkenntnis mehr erzeugen.4

Der definitorische Nullpunkt

Die herangezogene Literatur zu „alternativen Nachrichtenmedien“ arbeitet auffallend oft mit relationalen Formeln. Lisa Schwaiger beschreibt alternative Nachrichtenmedien als Gegenöffentlichkeiten in Opposition zur hegemonialen Öffentlichkeit aus Politik und Medien. Sie referiert „Definitionen“, wonach sich solche Medien als Alternative oder Opposition zum „Mainstream“ verstehen, den etablierten Informationsmedien und gesellschaftlichen Eliten kritisch gegenüberstehen und häufig soziale oder politische Veränderung beanspruchen. Bereits an dieser Stelle wird der methodische Ernst mürbe. Das ist keine harte Definition. Das ist eine Feldbeschreibung über Selbstverortung, Abgrenzungsgesten und Milieusprachen.5

Eine Definition, die über Selbstbeschreibung als Korrektiv zum Mainstream, Gegenöffentlichkeit oder Träger unterrepräsentierter Narrative läuft, erklärt am Ende alles und damit gar nichts. Sie erfasst nicht einen objektiv abgegrenzten Medientyp, sondern ein Verhältnis. Sie sagt nicht, was etwas ist, sondern nur, wie es sich selbst sieht oder wie es in Relation zu einem behaupteten Mainstream auftritt. Damit lässt sich im Zweifel fast jede politische Kommunikationsstruktur beschreiben, die sich als missverstanden, übergangen oder marginalisiert inszeniert. Ein schrumpfendes Parteimilieu mit ideologischer Selbstgewissheit und breitem medialem Vorfeld kann diese Formel ebenso erfüllen wie ein NGO-Komplex, ein klassischer Kommentarapparat oder eine publizistische Gegenblase jeder beliebigen Couleur. Wer das für eine tragfähige Definition hält, hält auch Nebel für Kartographie.6

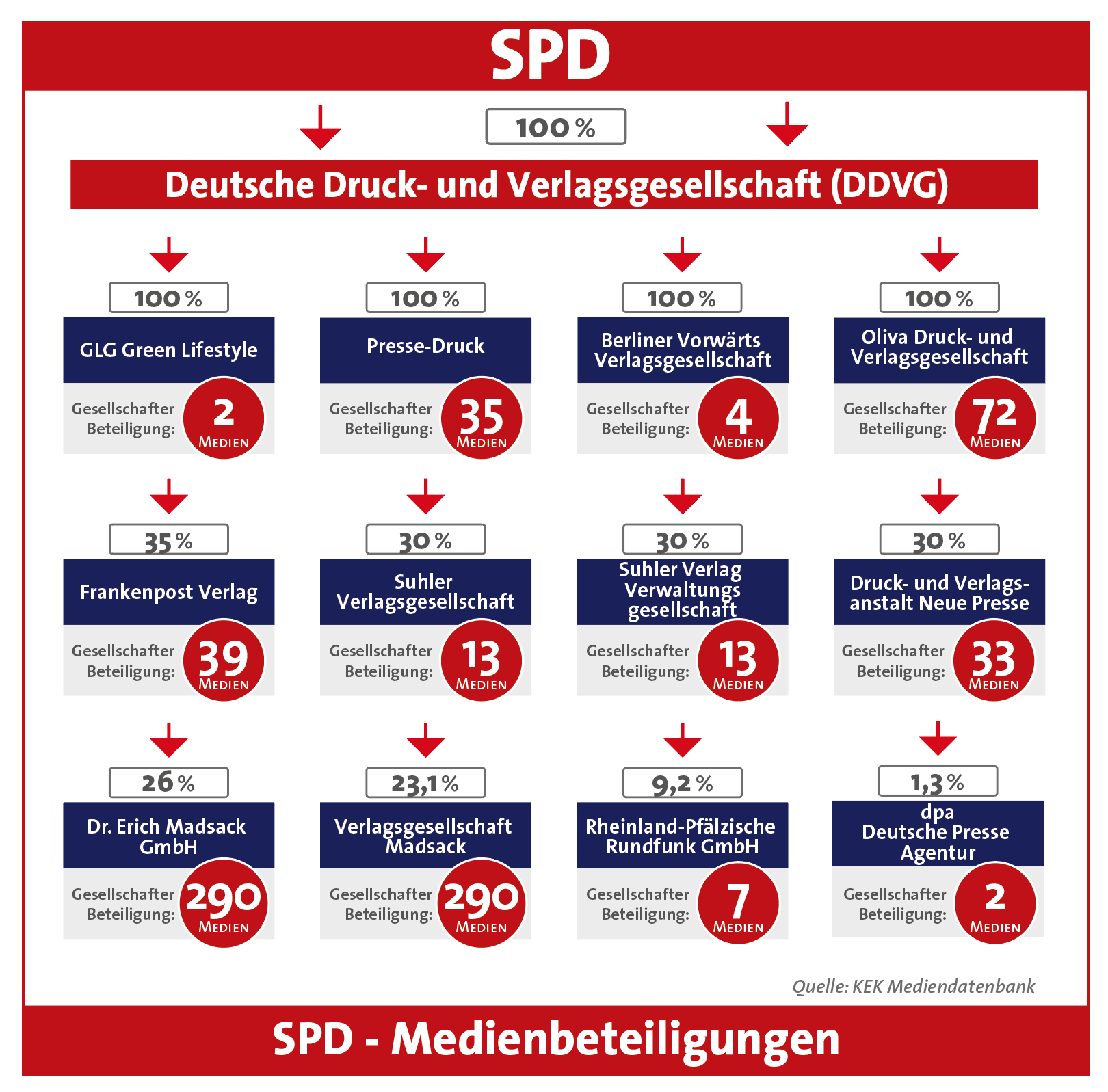

Ich nehme bewusst das Beispiel der SPD, gerade weil es die definitorische Beliebigkeit präszise freilegt. Eine Partei, die in manchen Ländern nur noch den Zuschnitt einer Splitterpartei hat, sich aber weiterhin über Stiftungen, Vorfeldorganisationen, Funktionärsnetzwerke, Verbandsnähe und publizistische Infrastruktur als politisch-moralisches Korrektiv zum vermeintlich verrohten Zeitgeist versteht, passt ohne Mühe unter dieselbe Formel.

Der Punkt ist nicht, die SPD deshalb als gesichert extremistisch zu etikettieren. Der Punkt ist viel simpler und viel peinlicher für MOTRA: Wenn dieselbe Definition auch dort greift, wo sie offenkundig nicht greifen soll, ist nicht die SPD das Problem, sondern der Bankrott der Definition.7

Schwaiger merkt das Problem selbst. Beim Sampling alternativer Online-Nachrichtenmedien schreibt sie ausdrücklich, die Definition von Alternativmedien habe sich an diesem ersten empirischen Schritt als wenig eindeutig erwiesen. Um das Feld dennoch abzugrenzen, habe man vorab Kriterien festgelegt. (sic!) Das ist bemerkenswert. Denn es bedeutet: Die Literatur, auf die sich MOTRA später stützt, beginnt selber mit einer definitorischen Unsicherheit und rettet sich dann in induktive Feldbearbeitung. Das kann man in einer explorativen Studie tun. Dann soll man aber später nicht so auftreten, als sei daraus ein fest umgrenzter Gegenstand mit sauberer Aussenkante geworden.8

Eine Markenliste ersetzt keine Begriffsarbeit

An dieser Stelle betritt MOTRA die nächste Stufe der Konstruktion. Das Greipl-Kapitel misst politische Alternativmediennutzung nicht über einen offen gelegten Kriterienkatalog, auch nicht über eine eigene Inhaltsanalyse, sondern über die Nutzungshäufigkeit konkreter Marken auf einer fünfstufigen Likert-Skala von „nie“ bis „sehr häufig“. Berücksichtigt werden acht Marken, die den Kategorien rechtsaussen, linksaussen und islamisch zugeordnet werden. Für rechtsaussen stehen Compact, Junge Freiheit und Tichys Einblick. Für linksaussen Junge Welt und Jungle World. Für islamisch IslamiQ, Islamische Zeitung und Al Jazeera.9

Genau hier liegt der definitorische Scharnierfehler. Eine Markenliste ist keine Definition. Sie ist eine Gruppierung. Das kann man in der Marktforschung machen. Man kann auch Mediennutzung nach Markenclustern ordnen. Nur darf man dann nicht so tun, als habe man damit einen wissenschaftlich sauberen Begriff des zu messenden Phänomens geliefert. Gemessen wird dann eben nicht „rechte Alternativmediennutzung“ im definitorisch strengen Sinn, sondern die Nutzung zuvor als rechtsaussen etikettierter Marken. Das ist ein fundamentaler Unterschied.

Das Kapitel gibt diese Setzung sogar offen zu. Es sagt, die Verortung der Medien in den Kategorien linksaussen und rechtsaussen sei in zahlreichen wissenschaftlichen Publikationen belegt, die Kategorie „islamisch“ dagegen streitbar und weniger eindeutig, ersichtlich der Kotau vor der Religion des Friedens. Deutschland, Land der Wirbellosen. Al Jazeera wird eigens als problematischer Grenzfall erwähnt. Danach wird die Messung dieser Kategorie 2024 eingestellt, auch wegen der Komplexität der Verortung. Man kann diese Passage als Transparenz loben. Man kann sie nüchterner lesen. Dann steht dort vor allem dies: Die Typologie ist nicht hart, sondern wackelt bereits unter der Last ihrer eigenen Grenzfälle.

Die methodische Konsequenz ist erstaunlich klar. Wenn schon die Klassifikation nicht über offen gelegte Kriterien, sondern über Literaturverweise und autoritative Zuordnung läuft, dann misst MOTRA keinen empirisch validierten Medientyp, sondern die Nutzung einer vorgängig etikettierten Liste. Die Erhebung ist also nicht die Vermessung eines klar definierten Gegenstands, sondern die Zählung von Kontakten mit Marken, die zuvor in einer bestimmten Literaturfamilie politisch verortet wurden. Genau deshalb ist die spätere Erkenntnisbehauptung so viel grösser als die tatsächliche Messleistung.

Der zweite Zirkelschluss

Auf der Einstellungsseite ist das Bild weniger leer, aber nicht wirklich beruhigend. Ich will fair bleiben: Hier gibt es mehr Operationalisierung als auf der Medienseite. MiD und die darauf aufsetzenden MOTRA-Berichte greifen bei der Erfassung rechtsextremer Einstellungen auf die sogenannte Konsensdefinition nach Decker et al. zurück. Erfasst werden sechs Subdimensionen Ausländerfeindlichkeit, Verharmlosung des Nationalsozialismus, Antisemitismus, Sozialdarwinismus, Chauvinismus und Befürwortung einer rechtsautoritären Diktatur. MiD ergänzt diese Struktur um Islamfeindlichkeit. Je nach Welle werden die Dimensionen durch ein oder zwei Items erfasst.10 11

Nur ist damit das definitorische Problem nicht gelöst, sondern bloss verschoben. Denn auch hier lebt die Autorität der Begriffe stärker als ihre Selbstverteidigung. „Befürwortung einer rechtsautoritären Diktatur“ etwa erscheint als eine der tragenden Subdimensionen. Wie aber wird dieser Begriff selbst definiert. Nicht hart im Kapitel. Nicht aus einer unabhängigen, präzisen Theorie heraus. Sondern faktisch wieder innerhalb derselben Literaturfamilie, die solche Marker verwendet und stabilisiert. Dasselbe gilt, wenn auch in anderer Form, für Chauvinismus, Sozialdarwinismus oder Antisemitismus im Rahmen genau dieses Instruments. Die Frage ist nicht, ob diese Phänomene real wären. Die Frage ist, ob die konkrete sozialwissenschaftliche Konstruktion hier ihre eigenen Kategorien scharf genug begründet, um starke Folgerungen zu tragen. Genau das geschieht nicht einmal Ansatzweise in der nötigen Strenge.

Mein persönliches Urteil ist an dieser Stelle schärfer als die höfliche Fachprosa. Ich habe MOTRA, Schwaiger 2022 und die herangezogene Decker-Literatur quergelesen und bleibe bei meinem Befund: Hier wird an zentralen Stellen Zirkelschluss betrieben. Wer „Rechtsextremismus“ über Literaturverweis absichert und dann Kategorien wie „Befürwortung einer rechtsautoritären Diktatur“ als tragende Marker verwendet, ohne diese ihrerseits begrifflich mit harter Aussenkante zu verteidigen, betreibt keine präzise Sozialforschung, sondern Laberwissenschaften mit esoterischem Anstrich. Das ist meine Wertung. Gesichert ist, dass die Konstrukte übernommen, verkürzt und normativ stark aufgeladen werden.

Hier entsteht ein geschlossenes Vokabular. Ein Begriff stützt den nächsten, der nächste verweist zurück auf den ersten, und die Literaturgemeinschaft bestätigt sich gegenseitig, dass das ausreichend sei. Wo ein Begriff nur durch Nachbarbegriffe gestützt wird, ohne harte definitorische Aussenkante, entsteht kein Erkenntnisgewinn, sondern begriffliche Inzucht. Das Ergebnis sieht von weitem geordnet aus, riecht aber nach einem wissenschaftlichen Betrieb, der sich seine Selbstverständlichkeiten selbst produziert und sie anschliessend mit dem Gewicht institutioneller Seriosität ausstattet.

Demokratiedistanz als moralischer Nebel mit Itembatterie

Noch deutlicher wird die Schieflage beim Begriff der Demokratiedistanz. Auch hier ist das Problem nicht, dass gar nichts operationalisiert wäre. Das MiD-Instrument nennt durchaus konkrete Items. Für 2021 verweist der Methodenbericht auf Einstellungen zu demokratischen Freiheitsrechten, Gleichheitsrechten und der konstitutionellen Verfasstheit des Staates. Der Monitor 2024/25 führt dafür zwölf Einzelitems an, etwa zum Recht auf Demonstration, zum Schutz der Pressefreiheit, zur freien Meinungsäusserung von Minderheiten, zur Gleichbehandlung bei Hautfarbe, Wohnraum und Religionsausübung sowie zu Fragen nach Wahlkritik, Gewaltenteilung und Parlamentsmacht. Über die Items lässt sich streiten. Aber nicht in diesem Beitrag.12

Das ist auf der Instrumentenseite real. Doch der Begriff „Demokratiedistanz“ bleibt trotzdem methodisch und semantisch in keiner Weise unproblematisch. Er ist kein neutraler Messbegriff, sondern ein wertender Container, der sehr unterschiedliche Einstellungen unter eine politisch bereits belastete Überschrift zieht. Das Instrument fragt nicht bloss nach Zustimmung zu konkreten Aussagen, sondern ordnet diese später unter einen Oberbegriff ein, der bereits eine Distanz zum demokratischen Gemeinwesen suggeriert. Wer so arbeitet, bewegt sich nicht mehr im Raum technischer Beschreibung. Er formt politische Semantik mit. Plausibel ist, dass solche Konstrukte im Sicherheitsdiskurs attraktiv sind, gerade weil sie unscharf genug bleiben, um als Frühwarnsprache zu funktionieren. Gesichert ist: Sie sind weit weniger unschuldig, als ihr tabellarischer Auftritt vermuten lässt.

Erhebung, Survey, Panel

MOTRA verkauft die MiD-Erhebungen als wiederholtes Monitoring. Methodisch betrachtet reden wir zuerst über eine jährlich wiederholte repräsentative Bevölkerungsbefragung mit Mixed-Mode-Design, nicht über ein kausales Prüfdesign. Die Berichte nennen repräsentative Befragungen der erwachsenen Bevölkerung ab 18 Jahren, eine Stichprobe von rund 4000 Personen in der ersten Welle, Oversampling von Personen mit Migrationshintergrund und muslimischer Religionszugehörigkeit, ein PAPI-CAWI-Design, Mehrsprachigkeit und Anhänge mit Fragebogen und Codebuch. Das ist eine Survey-Infrastruktur, kein Labor für harte Wirkungsnachweise.13 14

AAPOR formuliert dazu einen Satz, der in Deutschland viel öfter über den Schreibtischen der Sicherheitsforschung hängen sollte: Die Qualität einer Survey ist nicht an Grösse, Prominenz oder institutionellem Glanz zu messen, sondern daran, wie sorgfältig mit den zahlreichen Problemen umgegangen wird, die in Survey-Forschung entstehen. AAPOR fragt ausserdem ausdrücklich, ob eine Survey überhaupt das geeignete Werkzeug für die jeweilige Forschungsfrage ist. Das ist keine akademische Nebensächlichkeit. Es ist die erste methodische Gewissensfrage.15

Gerade an diesem Punkt springt der Widerspruch im Greipl-Kapitel ins Auge. Gemessen werden Selbstberichte über Nutzungshäufigkeit bestimmter Medienmarken und deren Korrelationen mit Einstellungsindizes. Gerahmt wird das Ganze jedoch mit Formeln wie „Radikalisierungsdynamiken“, „Schwächung demokratischer Institutionen“ und „Mainstreaming radikaler Ansichten“. Das Design kann solche Wirkungspfade nicht tragen. Es kann sagen, wer was angibt und mit welchen Skalenwerten das statistisch einhergeht. Es kann nicht belegen, dass diese Medien Menschen radikalisieren oder demokratische Ordnung erodieren lassen. Zwischen Messung und Deutung entsteht also eine Deutungshöhe, die das Instrument selber nicht absichert. (sic!)

Wiederholungen sind kein Radikalisierungsnachweis

Auch der Umgang mit Zeit gehört zu den grossen rhetorischen Tricks solcher Projekte. Eine jährlich wiederholte Befragung klingt schnell nach Entwicklung, Verfestigung, Abschottung, Verdichtung. Methodisch muss man viel nüchterner sprechen. Repeated cross-sectional designs erlauben Schätzungen von Veränderungen auf Populationsebene. Sie sind gerade nicht dafür gebaut, Wandel auf individueller Ebene robust nachzuweisen. David Steel hält das in der Survey-Enzyklopädie sauber fest: Wiederholte Querschnitte liefern gute Schätzungen für die jeweilige Bevölkerung zu einem Zeitpunkt; longitudinale Surveys dagegen sind für Individualveränderung gemacht. Oliver Lipps formuliert es ähnlich: Panels haben analytische Vorteile für Individualdynamik und Kausalität, repeated cross-sections nicht.16 17

Das ist für MOTRA keine Nebenbemerkung, sondern ein Grundsatzproblem. Wer mit Begriffen wie Abschottung oder Verdichtung hantiert, muss klar sagen, ob damit Populationstrends oder Individualverläufe gemeint sind. Das Greipl-Kapitel arbeitet de facto mit Wellenvergleichen und aggregierten Anteilen. Schon deshalb sind starke Aussagen über Verfestigung einzelner Personen oder Radikalisierungsverläufe methodisch überzogen. Man vergleicht nicht dieselben Köpfe in einem kausal abgesicherten Längsschnitt, sondern in erster Linie wiederholte Stichproben.

Kleine Teilgruppen, gewichtete Anteile, grosse Gewissheiten

Eine Stichprobe von 4000 Erwachsenen kann für grobe Bevölkerungsanteile durchaus brauchbar sein. Problematisch wird es dort, wo politisch aufgeladene Deutungen aus kleinen, weiter zerlegten Teilgruppen gezogen werden. MiD 2021 bestand aus etwa 4000 Befragten, davon rund 2000 Allgemeinbevölkerung und zwei Oversamples von je etwa 1000 Personen. AAPOR erinnert daran, dass Stichprobenfehler nur eine Fehlerquelle unter mehreren sind. Hinzu kommen Nonresponse, Coverage, Messfehler und Fehler durch Nachjustierung.18 19

Sobald MOTRA aus dieser Architektur Teilgruppen wie exklusive Rechtsaussen-Nutzer, rechtsaffine Nutzer bestimmter Marken oder kleine Segmente islamischer Mediennutzung herauszieht, wird die inferenzielle Lage deutlich fragiler. Das Kapitel selbst räumt ein, dass Reichweiten und Nutzungszahlen politischer Alternativmedien nur schwer exakt zu bestimmen sind. Bei den Rechtsaussen-Medien spricht es von 2 bis 3 Prozent Exklusivnutzung in der Bevölkerung, zugleich aber von 84 Prozent bis 97 Prozent Exklusivnutzung innerhalb der Rechtsaussen-Nutzer. Solche Verhältnisse klingen beeindruckend, stehen aber auf einer kleinen numerischen Basis. Je kleiner die relevante Gruppe, desto empfindlicher wird alles gegenüber Gewichtung, Missing Data, Moduseffekten und Klassifikationsentscheidungen.

Wer daraus grosse Gewissheiten ableitet, verwechselt Subgruppenarithmetik mit robuster Sozialdiagnostik. Für grobe Populationsschätzungen mag das Design reichen, für kleine und politisch brisante Teilgruppenurteile deutlich weniger. Roland Tichy hat diese Schwäche publizistisch gespürt. Er hat sie nur nicht präzise genug benannt.

Mixed-Mode, Antwortinstabilität, Messfehler

Die MiD-Erhebung wird im Mixed-Mode-Design durchgeführt. Befragte können Papier oder Online wählen, online stehen mehrere Sprachen zur Verfügung. Schon das macht das Design praktisch flexibel, methodisch aber anspruchsvoll. Don Dillman und Leah Christian haben früh gezeigt, dass selbst identisch formulierte Fragen je nach Survey-Mode unterschiedliche Antworten erzeugen können, und dass Änderungen von visueller Gestaltung, Kontext und Modus Messinstabilität auslösen. Spätere Arbeiten zur measurement equivalence in mixed-mode surveys und zu measurement mode effects gehen in dieselbe Richtung. Moduseffekte sind kein Randproblem, sondern eine der klassischen Quellen von Survey-Fehlern.20 21

Dazu kommt etwas, das jeder halbwegs erfahrene Sozialforscher weiss und im politischen Betrieb doch immer wieder vergessen wird: Dieselbe Person kann bei ähnlichen Fragen an unterschiedlichen Tagen unterschiedlich antworten. Stimmung, Frageeinbettung, Modus, Aktualitätsbezug, Framing und soziale Erwünschtheit beeinflussen die Antwort. Eine Survey ist kein Seelenröntgen, sondern ein Messvorgang mit Fehlerstruktur. AAPOR benennt genau das offen und fordert, Fragewortlaut, Reihenfolge, Modus und Responseprozesse systematisch mitzudenken.22

Was weist MOTRA hierzu im Greipl-Kapitel offen aus. Wenig. Gesichert ist, dass Methodenberichte, Instrumententwicklung, Stichprobe und Codebuch an anderer Stelle dokumentiert werden. Gesichert ist auch, dass die Anhänge Fragebogen und Codebuch enthalten sollen. Nicht hinreichend sichtbar im Kapitel ist hingegen eine robuste Sensitivitätsdiskussion zu Moduseffekten, Antwortinstabilität oder der Frage, ob und wie dieselben Konstrukte über mehrere Wellen und Modi wirklich messäquivalent gehalten wurden. Genau diese Lücke ist für einen strengen Review fatal.

Gewichtung als modellabhängiger Eingriff

Gewichtung ist nicht per se unseriös. Survey-Forschung kommt oft ohne Gewichtung gar nicht aus, gerade bei disproportionalen Stichproben und bekannten Nonresponse-Mustern. Pew beschreibt Gewichtung nüchtern als Korrektur für disproportionale Designs und Nichtteilnahme. Zugleich weist Pew darauf hin, dass Gewichtung Varianz erhöht, Design-Effekte produziert und im Extremfall durch Trimming wieder zurechtgestutzt werden muss. Jede Gewichtung ist also ein Modellierungsschritt mit Annahmen, Benchmarks und Zielkonflikten.23

Genau deshalb wird Gewichtung dort kritisch, wo kleine, politisch aufgeladene Teilgruppen im Spiel sind. Je kleiner und spezieller die Gruppe, desto grösser die Pflicht, Raking-Schemata, Trimmings, Design-Effekte, Benchmarks und Sensitivitätsanalysen offenzulegen. AAPOR verlangt methodische Transparenz, gerade weil Surveys andernfalls die Illusion einer Präzision erzeugen, die sie nicht besitzen. MOTRA verweist auf Methodenberichte und Codebücher. Das ist besser als Geheimniskrämerei. Nur entbindet es das Greipl-Kapitel nicht von der Pflicht, die entscheidenden Modellierungsschritte dort hinreichend sichtbar zu machen, wo später starke politische Schlüsse in den Raum gestellt werden.

Wer also aus gewichteten Kleinstsegmenten anschliessend mit gravitätischer Stimme über Radikalisierung, Demokratiegefährdung und ideologische Abschottung spricht, bewegt sich auf dünnem Eis. Nicht weil Gewichtung an sich schmutzig wäre, sondern weil sie die Beweislast für methodische Transparenz erhöht. Genau diese Beweislast wird im Kapitel nicht mit der Strenge eingelöst, die dem politischen Anspruch entspräche.

Der institutionelle Rückkanal

Man muss keine Motive unterstellen, um den institutionellen Rahmen ernst zu nehmen. MOTRA ist ein Forschungsverbund in der zivilen Sicherheitsforschung, mit ministerieller Förderung, BKA-Nähe und ausdrücklich gewünschtem Transfer in Politik und Praxis. Die Projektbeschreibung spricht von Prävention und Bekämpfung radikalisierter Gewalt als gesamtgesellschaftlicher Aufgabe, von Monitoring eines heterogenen Radikalisierungsgeschehens bis hin zu terroristischen Handlungen, von Wissenstransfer und von evidenzbasierter, repressiv und präventiv ausgerichteter Sicherheitspolitik. Das sind keine neutralen Wolkenformationen. Das ist ein Problemrahmen.

Dieser Rahmen beweist noch keine Fälschung, keine politische Weisung, keine plumpe Auftragsarbeit im primitiven Sinn. Aber er prägt, welche Begriffe plausibel erscheinen, welche Phänomene als relevant gelten und welche Sprache sich aufdrängt. Wer in einem Sicherheitsverbund Radikalisierung monitoren soll, wird nicht mit der Gelassenheit eines Mediensoziologen auf Gegenöffentlichkeit schauen, sondern mit der Empfindlichkeit eines Apparats, dessen Vokabular von Gefährdung, Prävention und Transfer lebt.

Roland Tichy als Anlass, nicht als Endpunkt

Roland Tichy ist auf reale Sollbruchstellen gestossen. Er hat gespürt, dass hier etwas begrifflich nicht stimmt, dass die Zahlen in einem grösseren politischen Apparat zirkulieren und dass das Vokabular des Extremismusmonitorings schnell zu einem Instrument publizistischer Stigmatisierung werden kann.

Nur bleibt Tichy an vielen Stellen auf halbem Weg stehen. Er polemisiert gegen das Ergebnis, wo die schärfere Kritik längst den Gegenstand selbst angreifen müsste. Er legt den Finger auf den Alarm, aber nicht tief genug in die methodische Wunde. Wer MOTRA wirklich zerlegen will, darf nicht bloss sagen, die Zahl sei falsch gelesen oder das BKA wolle freie Medien bekämpfen. Er muss zeigen, dass hier zuerst ein begrifflich weiches Objekt hergestellt, dann mit Etiketten versehen, anschliessend in einer Survey abgefragt, über normativ belastete Indizes aufgeladen und am Ende in einen sicherheitspolitischen Deutungsrahmen zurückübersetzt wird. Erst dort beginnt die ernsthafte Analyse.

Und genau deshalb ist MOTRA für mich nicht bloss eine unsaubere Untersuchung, sondern ein exemplarischer Fall dafür, wie der sicherheitspolitisch grundierte Wissenschaftsbetrieb sich seinen Gegenstand selbst erfindet. (sic!)

Schlussbemerkung

MOTRA erhebt Daten. Gesichert ist auch: Die Methodenberichte legen mehr offen, als man im publizistischen Streit oft wahrnimmt. Plausibel ist ferner, dass die Forscher nicht einfach beliebigen Unsinn zusammenschreiben, sondern innerhalb eines bestimmten sozialwissenschaftlichen und sicherheitspolitischen Paradigmas arbeiten. Mein Urteil bleibt dennoch hart. Denn genau dieses Paradigma ist an den entscheidenden Stellen begrifflich weich, kategorial autoritativ und inferenziell überdehnt. Die Medienseite kollabiert an einer Markenliste, die als Definition verkleidet wird. Die Einstellungsseite lebt von Konstrukten, deren Autorität grösser ist als ihre begriffliche Selbstverteidigung. Die Erhebung misst Selbstberichte, nicht Radikalisierungswirkungen. Die Wellenstruktur liefert Populationstrends, keine individuellen Verhärtungslaufbahnen. Kleine Teilgruppen werden mit gewichteten Anteilen in eine Gewissheit übersetzt, die das Instrument nicht verdient. Mixed-Mode und Antwortinstabilität werden nicht mit der Strenge verhandelt, die ein ernsthafter Review verlangen müsste. Und über all dem liegt ein institutioneller Sicherheitsrahmen, der dem Vokabular seine Schärfe gibt, lange bevor die Daten überhaupt sprechen.

Nicht die Datenerhebung an sich ist der Kardinalfehler, sondern die Kombination aus weicher Medienklassifikation, normativ aufgeladenen Konstrukten, schwacher Transparenz der entscheidenden Modellierungsschritte und einer Deutungshöhe, die das Survey-Design nicht trägt.

In eigener Sache

Diese Arbeit entsteht nicht im luftleeren Raum. Sie kostet Zeit, Geld, Infrastruktur und sie läuft seit langem unter den Bedingungen eines dokumentierten Rechtsstreits, den ich öffentlich offengelegt habe. Wer dazu beitragen will, dass meine publizistischen Texte, meine technischen Projekte und diese Form unabhängiger Arbeit fortbestehen, kann meine Spendenseite teilen oder mich direkt unterstützen.

Unterstützungsmöglichkeiten:

https://www.gofundme.com/f/rechtsverteidigung-existenzsicherung-arbeitsgericht-lisbon

Oder direkt hier:

Mille fois an alle Spender.

Quellen

- Roland Tichy, „Sie lesen alternative Medien? Dann sind Sie rechtsextrem, sagt das Bundeskriminalamt“, in: Tichys Einblick, 22. April 2026. https://www.tichyseinblick.de/tichys-einblick/motra/ ↩︎

- Simon Greipl, Julian Hohner, Heidi Schulze und Diana Rieger, „Wandel im Digitalen: (Dis-)Kontinuitäten in der Nutzung sozialer und politischer alternativer Medien im Kontext extremismusaffiner Einstellungen, 2021–2025“, in: Uwe Kemmesies u. a. (Hrsg.), MOTRA-Monitor 2024/25, Hamburg 2026, Abschnitte zur Messung politischer Alternativmediennutzung, zu Reichweiten, Exklusivnutzung und zum Zusammenhang mit Rechtsaffinität. https://www.motra.info/wp-content/uploads/2026/03/1_Greipl_PhaeMo.pdf ↩︎

- MOTRA, Projektbeschreibung, Stand 2026, insbesondere Abschnitte zu Förderstruktur, Relevanz, Zielsetzung, Transfer in Politik und Praxis sowie zur Formulierung einer evidenzbasierten repressiv und präventiv ausgerichteten Sicherheitspolitik. https://www.motra.info/motra-im-profil/projektbeschreibung/ ↩︎

- Lisa Schwaiger, Gegen die Öffentlichkeit: Alternative Nachrichtenmedien im deutschsprachigen Raum, Bielefeld 2022, Abstract sowie definitorische Passagen zur relationalen Bedeutung von Alternativmedien und ihrer Opposition zur hegemonialen Öffentlichkeit aus Politik und Medien. https://www.ssoar.info/ssoar/handle/document/77720?locale-attribute=de ↩︎

- Ebd. ↩︎

- Ebd. ↩︎

- Ebd. ↩︎

- Ebenda, Kapitel zum Sampling alternativer Online-Nachrichtenmedien, dort zur wenig eindeutigen Definition von Alternativmedien und zum induktiven Vorgehen bei der Feldabgrenzung. ↩︎

- Siehe Fn. 2. ↩︎

- Universität Hamburg, Forschungsberichte zu MiD und JuMiD 2022 bis 2024, insbesondere zu rechtsextremen Einstellungen auf Basis der Konsensdefinition nach Decker et al. und zur Erweiterung um Islamfeindlichkeit. https://www.jura.uni-hamburg.de/die-fakultaet/professuren/kriminologie/media/uhh-forschungsbericht-6.pdf ↩︎

- Universität Hamburg, Forschungsbericht No. 2 zu MiD 2021, dort zur Bildung der abhängigen Variablen „Rechtsextreme Einstellungen“ und zu den konkret verwendeten Items wie „Es gibt zu viele Ausländer in Deutschland“, „Juden haben in Deutschland zu viel Einfluss“ oder „Ein Staat sollte einen Führer haben, der das Land zum Wohle aller mit starker Hand regiert“. https://www.jura.uni-hamburg.de/die-fakultaet/professuren/kriminologie/media/uhh-forschungsbericht-2-neu.pdf ↩︎

- Universität Hamburg, Forschungsbericht No. 1 zu MiD 2021, Tabelle zum Erhebungsinstrument, dort zu demokratiedistanten Einstellungen, demokratischen Freiheitsrechten, Gleichheitsrechten und konstitutioneller Verfasstheit des Staates. https://www.jura.uni-hamburg.de/die-fakultaet/professuren/kriminologie/media/uhh-forschungsbericht-1.pdf ↩︎

- Rebecca Endtricht, Diego Farren, Katrin Brettfeld, Jannik M. K. Fischer und Peter Wetzels, People in Germany 2021. First wave of the German national representative survey: Methodology, survey design and sampling, Hamburg 2023, zu Stichprobe, jährlicher Wiederholung, Oversampling, Mixed-Mode-Design, Response-Informationen und Codebuch. https://www.fdr.uni-hamburg.de/record/12244 ↩︎

- Katrin Brettfeld, Thomas Richter, Peter Wetzels und Janosch Kleinschnittger, Menschen in Deutschland: International (MiDInt). Untersuchungsdesigns, Stichproben, Erhebungsinstrumente und Codebuch zu den Wellen 7 bis 14, Hamburg 2025, dort zum Wortlaut der Instrumente und Codebücher im Anhang. https://www.fdr.uni-hamburg.de/record/18212 ↩︎

- American Association for Public Opinion Research, Best Practices for Survey Research, zu Eignung von Surveys für Forschungsfragen, Frageformulierung, Messfehlern, Nonresponse und Gewichtung. https://aapor.org/standards-and-ethics/best-practices/ ↩︎

- David Steel, „Repeated Cross-Sectional Design“, in: Encyclopedia of Survey Research Methods, zur Unterscheidung zwischen repeated cross-sections und longitudinalen Surveys sowie zu Populationstrends versus Individualveränderung. https://methods.sagepub.com/ency/edvol/encyclopedia-of-survey-research-methods/chpt/repeated-crosssectional-design ↩︎

- Oliver Lipps, Panel surveys: advantages and disadvantages compared with repeated cross-sectional surveys, FORS Guide 14, Lausanne 2020, zu den analytischen Vorteilen von Panels für Individualdynamik und Kausalität. https://forscenter.ch/fors-guides/fg-2021-00014/ ↩︎

- Siehe Fn. 13. ↩︎

- Siehe Fn. 15. ↩︎

- Siehe Fn. 13. ↩︎

- Don A. Dillman und Leah Melani Christian, „Survey Mode as a Source of Instability in Responses across Surveys“, 2005, sowie weiterführende methodische Arbeiten zu measurement mode effects in mixed-mode surveys. https://journals.sagepub.com/doi/10.1177/1525822X04269550 ↩︎

- Ebd. ↩︎

- Pew Research Center, methodische Dokumentationen zu Gewichtung, Raking, Trimming und Design-Effekten in Survey-Forschung. https://www.pewresearch.org/internet/2011/11/09/methodology-175-2/ ↩︎